이미지 확대보기

이미지 확대보기외신 보도에 따르면 2023년 이후 최근 HBM3 DRAM 가격이 5배 이상 오른 것으로 알려졌으며, 제조사인 삼성과 SK하이닉스의 HBM 주문이 급증할 것으로 예상된다.

◇HBM 시장규모 놀랍게 성장

SK하이닉스 박정호 부회장은 챗GPT와 같은 애플리케이션이 AI의 새로운 시대를 열면서 관련 기술의 진화와 함께 글로벌 데이터 생성, 저장 및 처리량이 기하급수적으로 증가할 것으로 예상한다고 말했다.

SK하이닉스는 엔비디아에 챗GPT용 NVIDIA A100 GPU와 함께 3세대 HBM D램을 공급한다. AI 서버 수요가 크게 늘고 있어 GPU를 지원하는 GDDR과 HBM 비디오 메모리 수요는 DDR, LPDDR에 이어 새로운 메모리 성장 영역이 될 것으로 보인다.

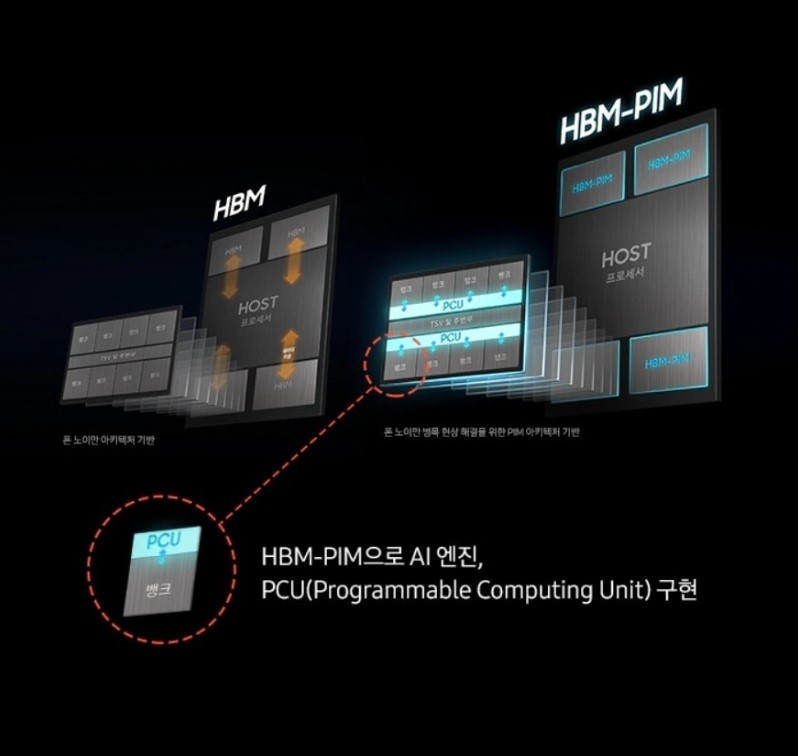

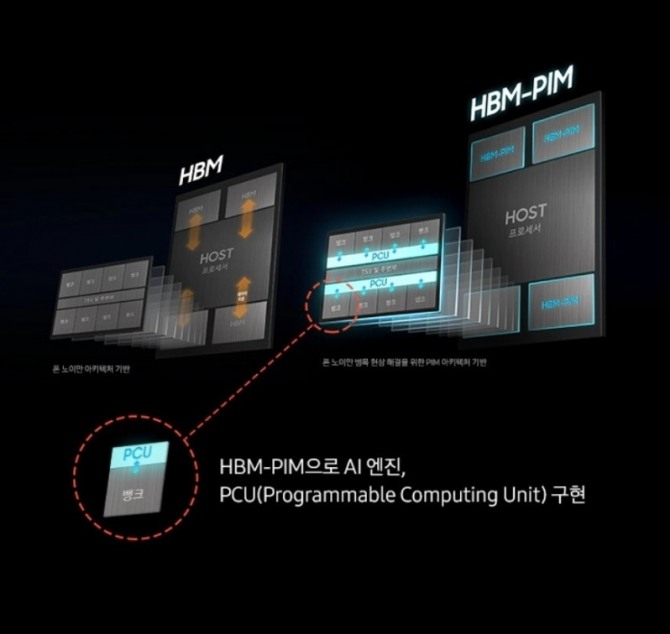

실제 AI 애플리케이션의 급속한 성장으로 AI 서버에 필요한 D램 용량은 기존 서버의 8배에 달해 D램 수요가 크게 증가하고 있다. HBM은 메모리 용량과 대역폭의 병목 현상을 극복해 차세대 D램 솔루션으로 간주되고 있다.

AI 대화 프로그램은 연산 수행 시 대용량, 고속 저장 지원이 필요하다. 이 챗GPT 개발은 HBM에 대한 수요를 더욱 확대할 것으로 보인다.

HBM은 고급 마이크로 반도체로 분류된다. SK하이닉스가 주도한 3D 스택 공정 기반의 고성능 D램이다. HBM은 메모리의 전력 소비 효율과 데이터 처리 속도 향상이 요구되는 시장의 기대를 총족한다. 현재 가장 빠른 D램 제품이다.

와트당 대역폭은 GDDR5보다 3배 이상 높으며, 표면적의 94%를 절약한다. GDDR5보다 넓다.

현재 HBM은 GPU, 네트워크 스위칭 및 포워딩 장치(라우터 및 스위치), AI 가속기, 슈퍼컴퓨터 및 고성능 서버에 주로 설치된다. HBM은 전체 D램 시장의 약 1.5%를 차지하고 있으며 전체 시장점유율은 아직 낮다.

하지만, AI 기술이 고성능 컴퓨팅에 대한 수요를 계속 확대함에 따라 HBM 매출은 빠른 성장을 예고하고 있다. 트렌드포스(TrendForce)에 따르면 HBM 시장의 연평균 성장률은 2023년부터 2025년까지 40~45% 이상 성장할 것으로 예상된다.

한 조사에 따르면 HBM 시장은 2017년 5억6730달러, 2020년 10억 달러, 2023년 38억4200만 달러로 성장할 것으로 예측한다. 이 추세라면 2030년에는 200억 달러에 육박하는 시장이 된다.

칩 수요가 많은 중국의 경우도 지능화, 디지털화 및 정보 기술의 심층적인 발전으로 다양한 분야에서 고성능 스토리지 제품에 대한 수요가 계속해서 증가할 전망이다. 당연히 HBM에 대한 수요는 상대적으로 높을 것이다. 이 HBM 수요는 2025년에 100만 개를 넘어설 것으로 추정된다.

◇HBM 선두주자, SK하이닉스와 삼성전자

HBM1에서 HBM3에 이르기까지 SK하이닉스와 삼성은 선두 기업이다. 특히 SK하이닉스는 2021년 10월 세계 최초로 HBM3 개발을 완료했고, 2022년 6월 HBM3 D램 칩을 양산해 엔비디아에 공급하고 있다. 시장에서 리더십을 공고히 하고 있다. 또한, 엔비디아는 SK하이닉스의 4세대 HBM을 H100에 탑재했다.

HBM은 하이테크 문턱 산업에 속해 있으며, 해당 산업에 속한 기업이 매우 적고, 앞으로도 오랫동안 이 분야에 진입할 수 있는 기업이 매우 제한적일 것이다. SK하이닉스와 삼성이 앞선 기술력과 지속적 제품 및 서비스 역량으로 전 세계 주요 HBM 시장을 점유하고 있다. 특히 SK하이닉스는 HBM 기술과 상대적으로 큰 시장 점유율을 차지하고 있다.

박정한 글로벌이코노믹 기자 park@g-enews.com